[LG]《SpeCa: Accelerating Diffusion Transformers with Speculative Feature Caching》J Liu, C Zou, Y Lyu, F Ren... [Shanghai Jiao Tong University & The Hong Kong University of Science and Technology] (2025)

SpeCa:革新性“预测-验证”框架加速扩散Transformer推理,突破序列依赖与计算瓶颈

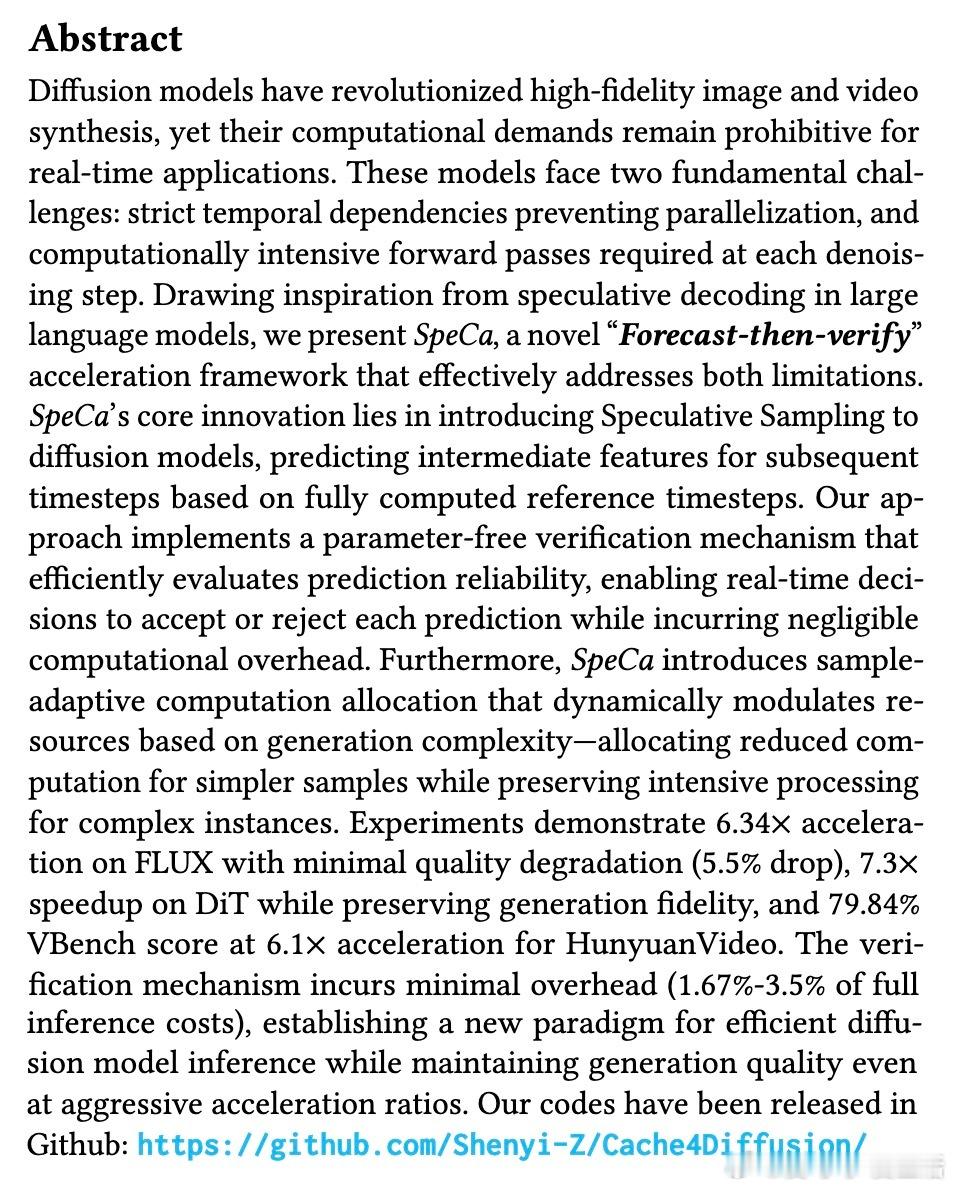

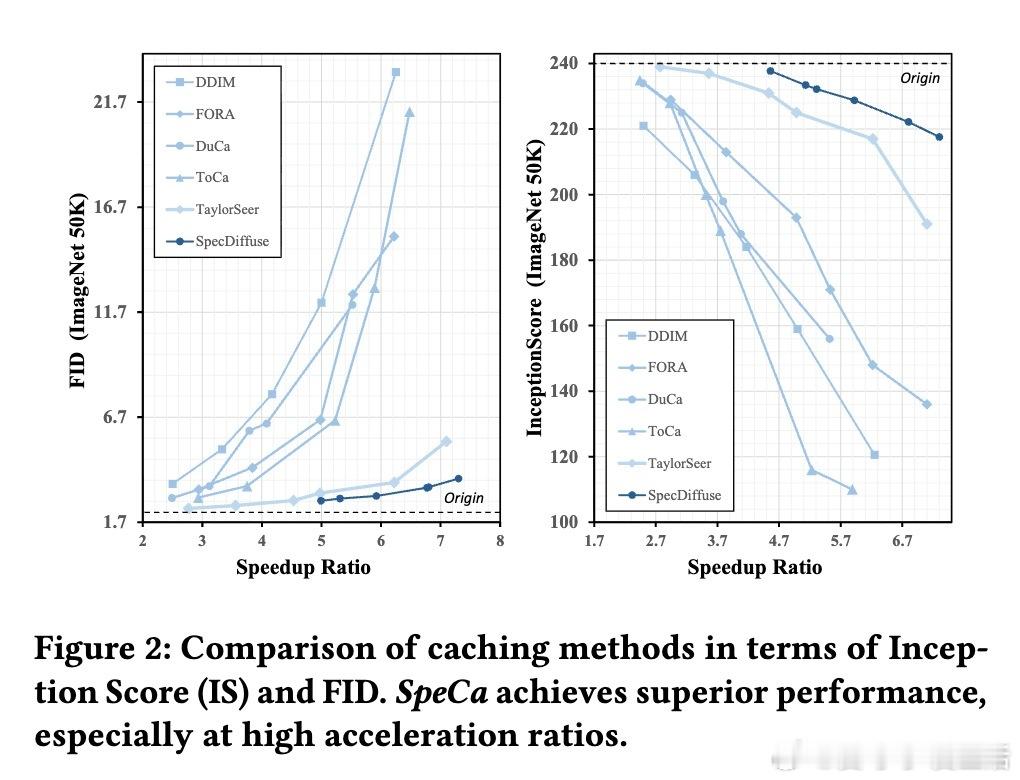

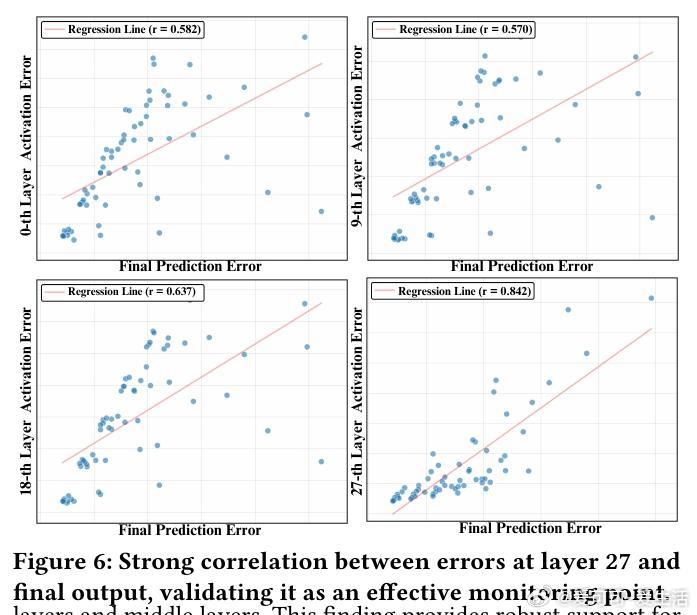

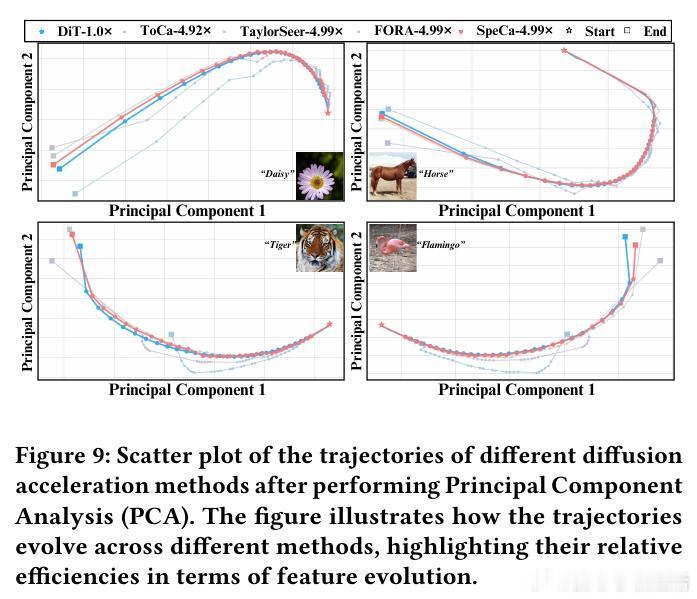

• 核心创新——引入“Speculative Sampling”:基于关键时间步的完整特征,轻量级TaylorSeer草稿模型预测多个后续时间步特征,辅以参数无关的相对误差验证机制,实现预测的动态接受或拒绝,极大提升推理速度同时控制误差累积。

• 自适应计算分配:针对样本复杂度动态调整推理资源,简单样本获得更高加速比,复杂样本保障生成质量,兼顾效率与视觉质量。

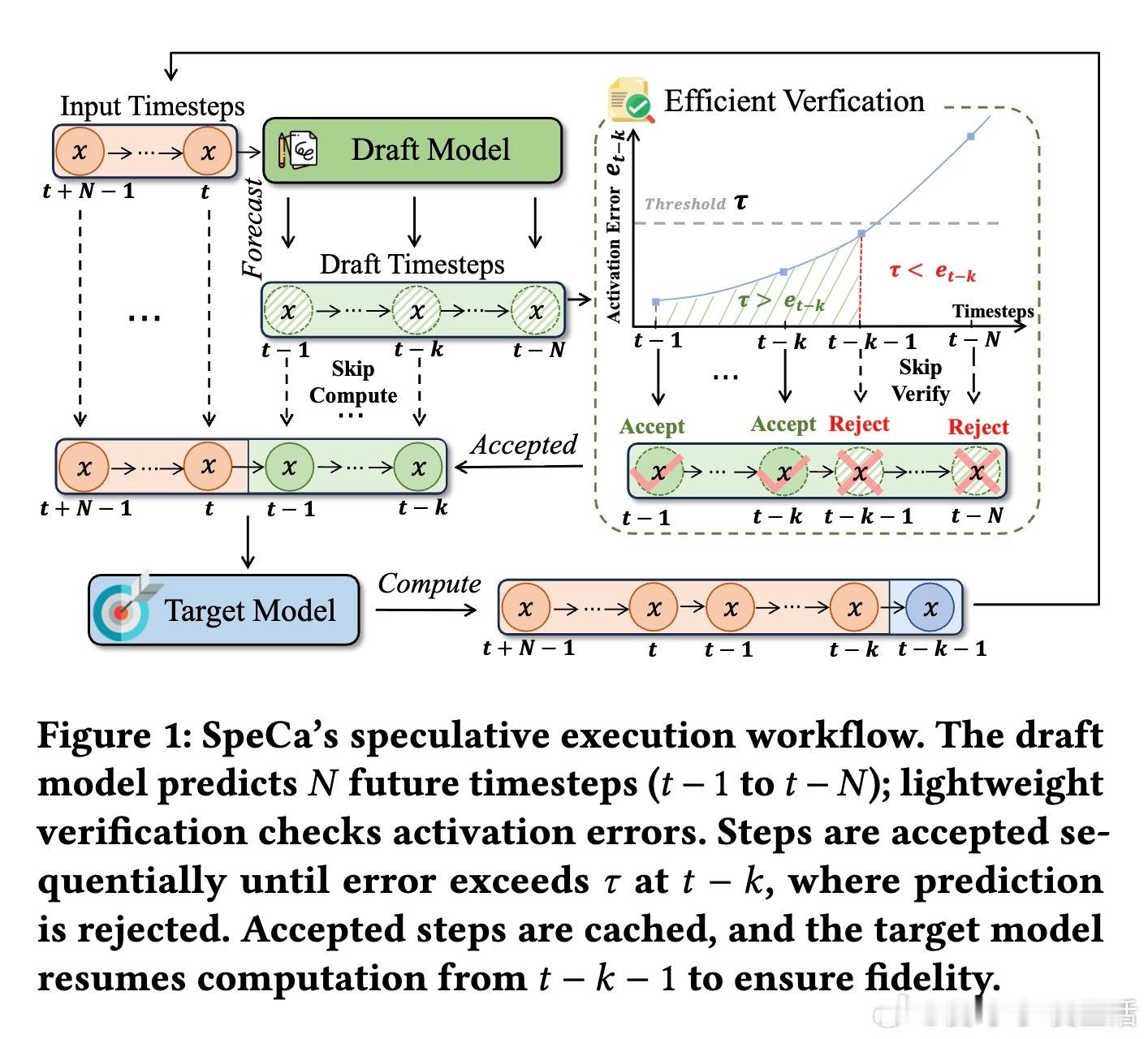

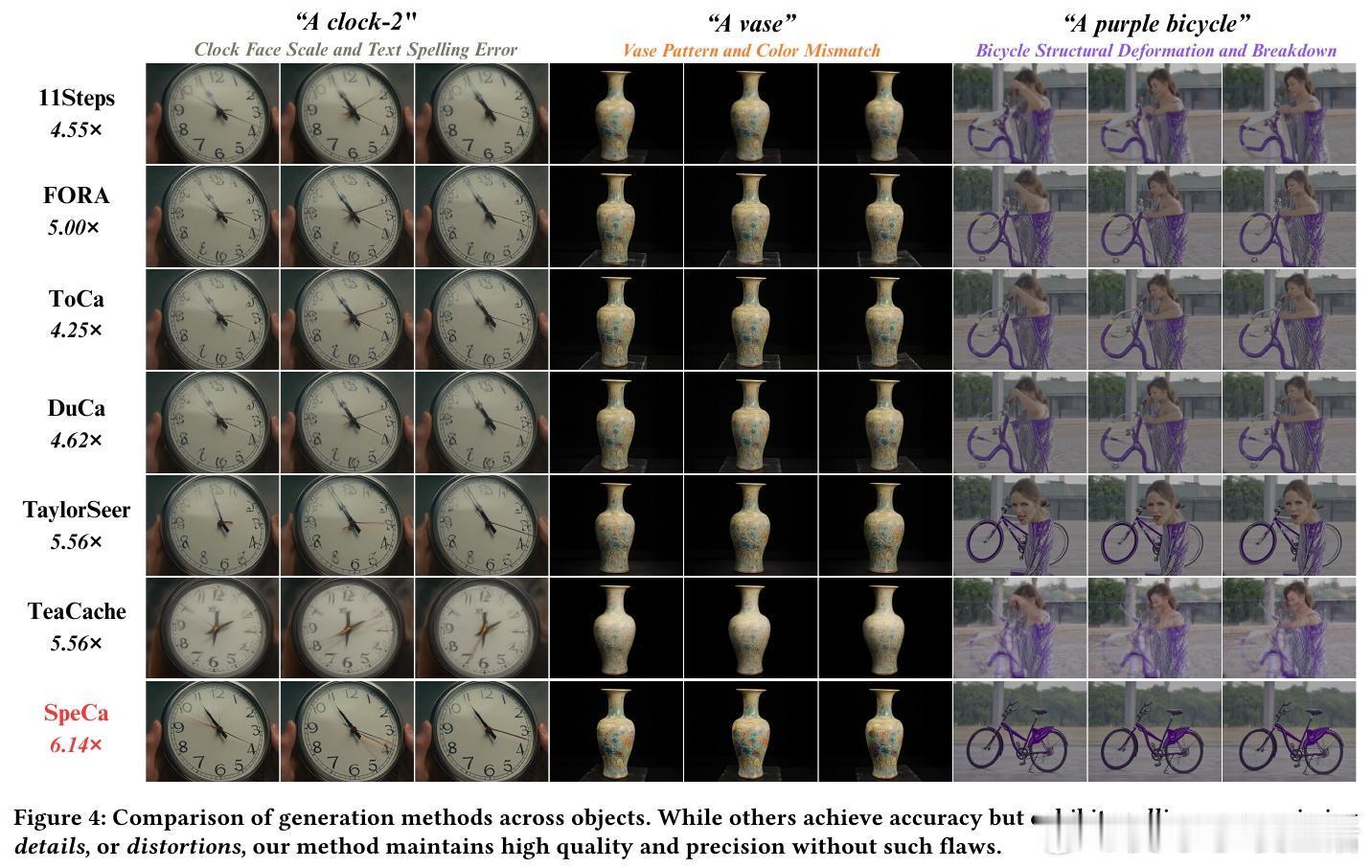

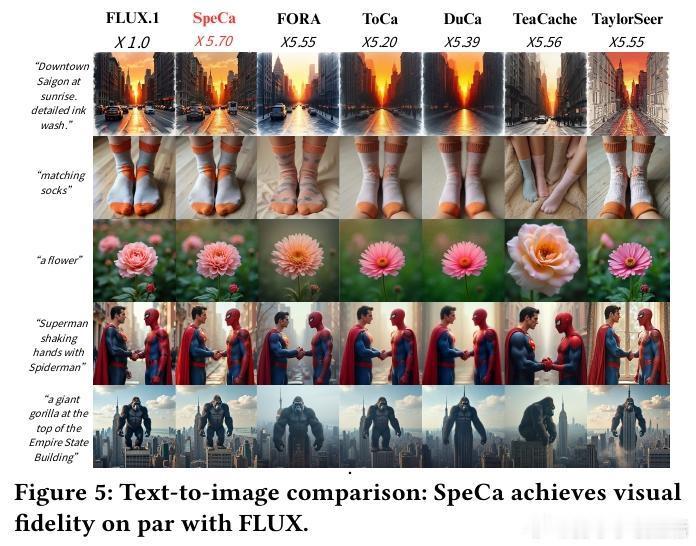

• 实验表现:在FLUX模型上实现6.34×加速,图像质量仅下降5.5%;在DiT模型中保持7.3×加速下高保真生成;在计算密集的HunyuanVideo视频生成中达6.1×加速并获得79.84% VBench评分,验证机制开销极低(约1.67%-3.5%),引领扩散模型高效推理新范式。

• 理论保障:基于Taylor级数展开的预测误差有界性证明,结合分布收敛性与马尔可夫过程分析,确保加速推理下生成分布与原模型高度一致。

• 兼容性强:无需额外训练,SpeCa可即插即用地集成于现有扩散Transformer架构,适用多模态生成任务,极大拓展实用边界。

心得:

1. 通过在特征层面引入“预测-验证”机制,有效解决传统缓存方法加速时误差累积导致的质量崩溃,体现了对扩散过程动态特性的深刻理解。

2. 自适应分配计算资源打破“一刀切”限制,反映了对生成任务多样性和复杂度的精准把控,实现效率与质量的平衡。

3. 轻量级误差验证的设计兼顾计算成本与判别准确性,彰显实用系统设计的前瞻性与工程智慧。

详细了解👉 arxiv.org/abs/2509.11628

代码开源👉 github.com/Shenyi-Z/Cache4Diffusion

扩散模型Transformer推理加速生成模型机器学习计算机视觉