出品 | 创业最前线

作者 | 白华

编辑 | 闪电

美编 | 李雨霏

审核 | 颂文

2024年,国内人工智能产业有了许多变化:如行业焦点从基础大模型转向AI原生应用、大模型在企业的场景从POC(内部试点)阶段融入日常的业务操作中从“技术战”到商业落地的“价格战”……

在这场变革中,火山引擎凭借卓越的创新能力,迅速崭露头角,或将成为大模型时代落地的典型代表。

5月15日,火山引擎在"2024春季Force原动力大会"上,从基座模型到上层应用均发布了系列产品与服务。携手亮相的豆包模型家族,不仅在企业内部取得了显著的成绩,且已经开始向外拓展,并降低了大模型的使用成本,引领行业进入“厘时代”。与此同时,火山引擎还升级了火山方舟2.0服务平台,进一步加速了大模型的落地,并解决了企业在AI应用落地方面的技术问题。

那么,随着AI技术的不断进步和市场扩大,火山引擎的战略布局是怎样的?其在大模型时代的先进理念与洞察有哪些?未来将如何继续深耕企业AI服务,帮助企业轻松构建与落地高质量AI应用?

1、全面融入AI应用,300+大模型如何选?可以预料的是,在未来一年,大模型将不再是空中楼阁或测试玩具,它们将全面融入各类AI应用中,开启企业级AI应用的新纪元。

但在走向如此美妙的未来之前,绝大多数的企业使用大模型时必然会遭遇四大挑战:大模型的成本高、落地难、选型难、安全信任问题。

其中,最不能忽视的就是大模型的成本高,难控制。

对于许多大模型厂商而言,如何有效控制模型成本是一个重要的问题。假设成本过高,可能会对想要采购大模型的企业造成压力,尤其是财务压力,甚至影响项目的可行性。相关报道显示,企业应用大模型的成本至少在百万级起步,甚至可能达到上千万元。

火山引擎总裁谭待在“2024春季Force原动力大会”上一语道破真相,大模型落地绝非易事,推理的成本太高是挑战之一。“只有非常低的成本服务,才能够让大模型广泛地应用起来。”

其次是大模型落地难度大。

因为大模型从理论阶段转化为实际应用,是一个复杂而困难的过程,企业需要解决数据整合、模型部署、接口开发、用户培训等一系列问题。

中国信息通信研究院发布的《人工智能研发运营体系(MLOps)实践指南(2023年)》中指出,AI当前面临着生产转化率不高的问题,其原因体现在跨团队协作难度大、过程和资产管理欠缺、生产和交付周期长等方面。

此外,大模型的选型难以抉择也是一大问题。

公开资料显示,当前国内已发布超过300+大模型,每一家的模型参数、侧重能力、配套设施等均不相同,同时不同行业的应用场景也五花八门,企业用户对大模型的落地诉求不一。并且,由于缺乏对模型性能、适用性和可维护性的深入了解,企业往往难以做出明智的决策。

谭待也认同这个观点。“我们需要有更多的工具、更多的插件、更多的平台和应用,来帮助企业在更多的场景里面,更容易地去做好大模型落地。”

最后是老生常谈的安全信任问题。

大模型由于复杂的结构和庞大的数据量,往往面临着更高的安全风险。如何确保模型的安全性、保护用户隐私以及防止模型被恶意利用是企业需要重点考虑的问题。

就如今国产模型的进度与应用程度来看,厂商展现的能力,只是大模型的第一步。在即将到来的“AI应用时代”,谁能攻克上述问题,并精准助力大模型高效落地与应用,或许就能在这场AI浪潮中独领风骚!

2、火山引擎双翼齐飞:价格亲民化与应用实战落地化面对大模型落地的重重挑战,国内外企业都在积极解决。火山引擎已经走在前列,强势出击,以新一代全栈AI服务为企业保驾护航。

5月15日,谭待在“2024春季Force原动力大会”上宣布,字节跳动自主研发的豆包大模型将通过火山引擎正式对外提供服务。

值得注意的是,豆包大模型并不仅仅是一款模型,而是一个模型家族,主要包括豆包通用模型Pro、豆包通用模型Lite。此外,还拥有角色扮演、语音合成、声音复刻、语音识别等多元化模型。

其中,豆包通用模型Pro,作为家族的明星成员,其理解、生成、逻辑、记忆能力均达到业界顶尖,支持128K上下文,让AI更加智能。而在保证基础质量的同时,豆包通用模型Lite相比于Pro,它的千Tokens成本会下降84%。

一个典型例子是智能驾驶、智能座舱的交互场景下,在汽车搭载了豆包lite大模型后,汽车厂商可以在低延迟下实现对话,支持闲聊、搜索、娱乐、导航、车控等多个座舱智能助手场景,效果要比传统语音处理高50%以上。

豆包模型家族的“正式营业”,勾勒出字节跳动AI版图的宏伟蓝图:火山引擎负责基座模型、开发者生态的构建,为字节跳动内部多元AI应用的成长提供支撑。

经历业务的“淬炼”,豆包大模型已经跑出了诸多差异化的竞争能力。最值得一提的是,其降低了AI使用的门槛与成本,开启大模型价格进入“厘时代”。

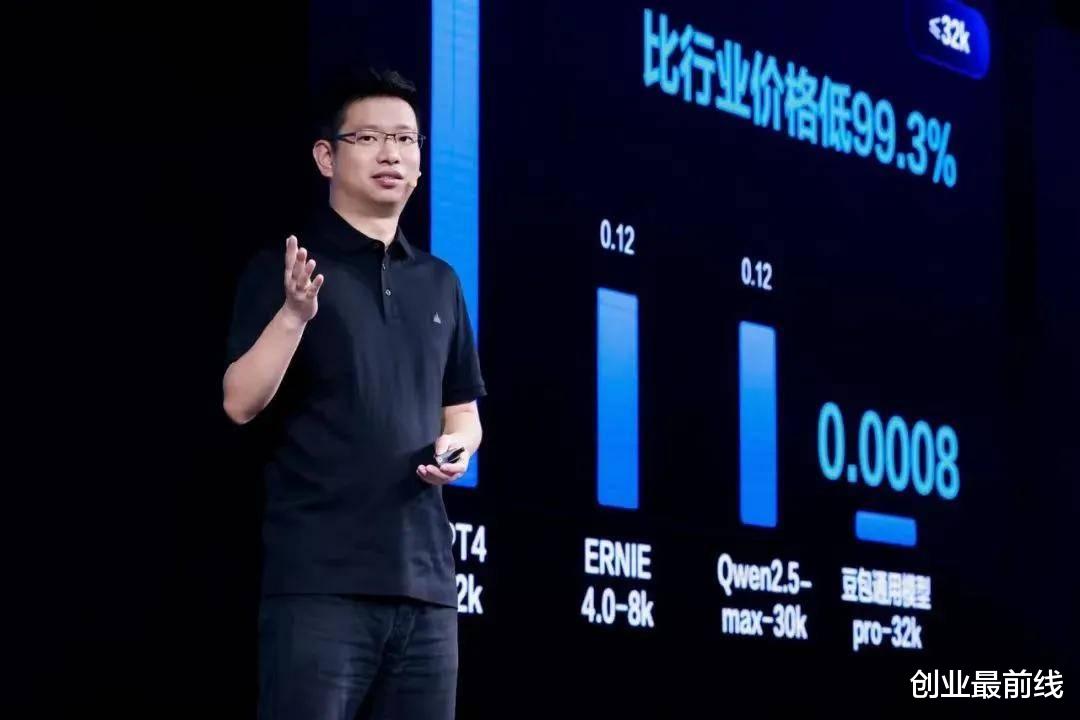

在目前市场上,企业使用大模型生成1千tokens的成本参差不齐。例如国际巨头GPT4的价格高达0.42元/千tokens,国内百度文心一言、阿里最新的千问2.5Max等主要大模型,基本稳定在0.12元/千tokens。

而豆包大模型的定价大幅低于行业价格:豆包通用模型pro-32k版,价格仅为0.0008元/千tokens,比行业的价格降低99.3%。豆包通用模型pro-128k版本,价格为0.005元/千tokens,仅是GPT4-Turbo128K(0.07元/千tokens)定价的7%。

「界面新闻·创业最前线」算了一笔账,一家企业选择采用大模型,为确保效果达到最佳,往往需要处理高达100亿tokens的数据量。根据当前国内大模型的市场价格,企业预算至少达到120万元。现在有了豆包大模型,使用通用模型pro-32k版的成本只需8000元。

豆包大模型大幅降价背后,反映了火山引擎的价值观,“好的模型一定要让每一个人、每一家企业都用得起来”。

「界面新闻·创业最前线」观察到,当前国内大模型已从“技术竞赛”转入“价格肉搏”的初级阶段。各大厂商正试图通过低价策略降低AI使用的门槛,以吸引更多用户,扩大市场份额,这一趋势在今年内将持续发酵。

谭待认为,降低成本是推动大模型快进到“价值创造阶段”的一个关键因素。

而为了加速大模型与AI应用的落地,火山引擎也将提供更多的插件和工具平台辅助企业用好大模型。

在最新的发布会上,火山引擎全新升级了方舟2.0平台,并且新平台发布了3个重要的大模型插件。

一是联网插件能够提供头条抖音同款搜索能力,实时连接海量优质互联网数据,不断从新的数据和信息中学习,从而提高其性能和适应性等。

二是内容插件,能够提供头条抖音同源海量内容,支持多模态交互,提供基于意图的垂类内容信息检索,内容时效检索更强,帮助大模型深入理解、检索和生成内容。

三是RAG知识库插件,能够支持将企业的私域数据注入大模型中,实现毫秒级百亿规模的高性能检索,秒级流式知识库索引更新。

除上述三个核心插件之外,方舟2.0此次也全面升级了系统承载能力、安全保护能力和算法服务能力进行升级。

如今,随着豆包大模型与火山方舟2.0底层能力的提升,火山引擎必将加速企业级AI应用的落地,推动整个行业向智能化时代迈进。

3、共筑大模型生态新篇章,成立两大联盟除了上述产品外,火山引擎更是在大模型生态方面下了一盘大棋。

火山引擎宣布成立了两大联盟,分别是智能终端大模型联盟和汽车大模型生态联盟,这展现了火山引擎对于未来AI应用的深刻洞察和坚定决心。

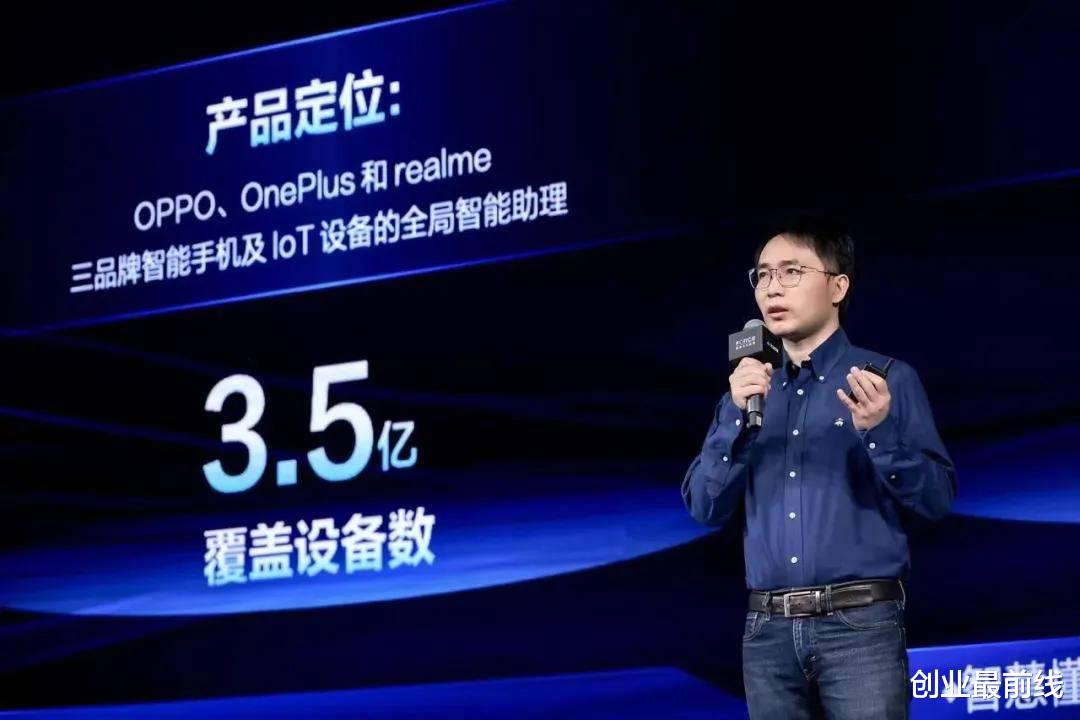

OPPO与火山引擎的合作堪称典范。OPPO打造的产品叫小布助手,用户希望小布能够理解用户的偏好,在合适的地点、时间提供更加个性化、更加主动的服务。

OPPO智能助理部部长、小布助手首席架构师万玉龙直言:“为了满足用户需求,实际落地过程中,小布需要结合大模型的发展,至少做好四大类产品功能,包括系统操控、通用问答、品牌问答和内容创作。”

双方合作聚焦于两大核心领域,一方面通过火山搜索增强技术,优化了小布助手的通用问答体验,同时借助火山引擎的庞大知识库,OPPO在知识问答上提供了精确回应。另一方面双方携手,基于豆包大模型,通过数据精调和Prompt技术,打造了多个垂直领域的智能模型,如模拟面试、英语教学、情感陪聊等,有效解决了用户痛点,赢得了良好口碑。

火山引擎在手机领域的推进尤为迅猛。其大模型服务已逐渐融入众多合作伙伴的产品中,包括OPPO小布助手、荣耀MagicBook的YOYO助理、小米"小爱同学",以及华硕笔记本电脑的豆叮AI助手等知名品牌。同时,在汽车领域,火山引擎也携手吉利汽车、长城汽车、捷途汽车等20余家厂商,共同推动汽车智能化进程。

以捷途汽车使用火山引擎的大模型为例,双方在销售场景上取得了一些效果。主要是双方一起在训练销售培训大模型的能力,通过初步的PUC和电话语音质检,针对销量不佳的特定区域进行了深入分析。结果显示,该地区80%的销售顾问,在话术评分上低于40分,核心问题在于直接沟通、缺乏需求探索和同理心交流。

于是,双方提出了一些创新策略,例如利用大模型技术为每个销售顾问配备智能助手,负责日常销售档案的整理、客户沟通内容的记录,以及自动建档和提醒功能,从而确保销售流程的规范化和数据化。还引入专业销售分析系统,类似于“军师”,协助销售在接待客户时,作出更精准的销售决策。

从金融到消费,从手机到汽车,火山引擎以其独特的大模型技术和应用工具,为各行各业的客户提供了高效、精准、个性化的服务。未来,火山引擎或许将成为AI时代不可或缺的重要选手。

*注:文中配图来自火山引擎官微。